306XR wrote:特斯拉前鏡頭是三鏡頭...

4. 攝像頭,TELSA 最大的問題,是用手機的一組鏡頭(對,現在手機也用3鏡頭了,可以有景深) ,無法作 立體像對,亦即無法提供 3D像片,作距離及立體物件建置

306XR wrote:

4. 攝像頭,TELSA 最大的問題,是用手機的一組鏡頭(對,現在手機也用3鏡頭了,可以有景深) ,無法作 立體像對,亦即無法提供 3D像片,作距離及立體物件建置

???

分享光達知識很好,但請不要拿客觀知識偷渡自己的主觀執念,也記得多關注一下對手已經走多遠,以下都是業外人士在網路就查得到的東西而已...

《TESLA小知識》前方三鏡頭組簡介

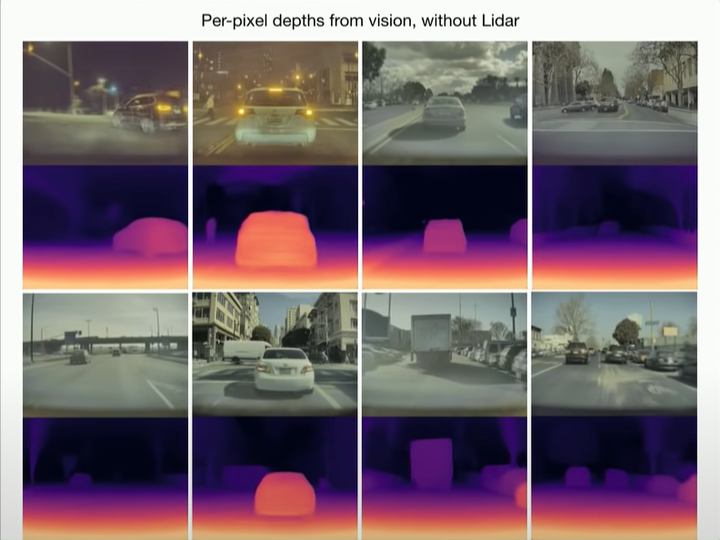

不需光達,以單一鏡頭的影像就能準確判斷周遭環境的「深度」(距離)

《Autopilot》AK談論AP開發細節 (2020/02)

遮到剩一個主鏡頭還能在路口轉彎

《Autopilot》FSD初探25-遮住鏡頭還能在路口轉彎嗎?

https://fb.me/TeslaHere|TESLA知識家

306XR wrote:

關鍵字都已經不小心打(恕刪)

應該這樣說,單一鏡頭的傳統影像的確是無法在物理上取得景深(除非CMOS能有更進一步的功能),要靠影響取得景深有兩個方法,一個是靠雙鏡頭之間的gap,來反推景深,另一個是用演算法透過機器學習的方式來判斷景深,特斯拉應該是兩者都有用到。

用訓練的方式的缺點應該是能判斷物件的前後順序(相對距離),但是沒辦法取得絕對距離,

我個人是支持短距離30米內,應該採用例如intel 或是apple的陣列式短距離光達,但是遠距離,光達的侷限性太大,可以用影像。

內文搜尋

X