要拿掉 xformers 才可以, 因為 xformers 會嘗試使用 NVIDIA CUDA

command line 執行

pip uninstall xformers 解除安裝 xformers

webui-user.bat 內容

@echo off

set PYTHON=

set GIT=

set VENV_DIR=

set COMMANDLINE_ARGS= --lowvram --precision full --no-half --skip-torch-cuda-test

call webui.bat

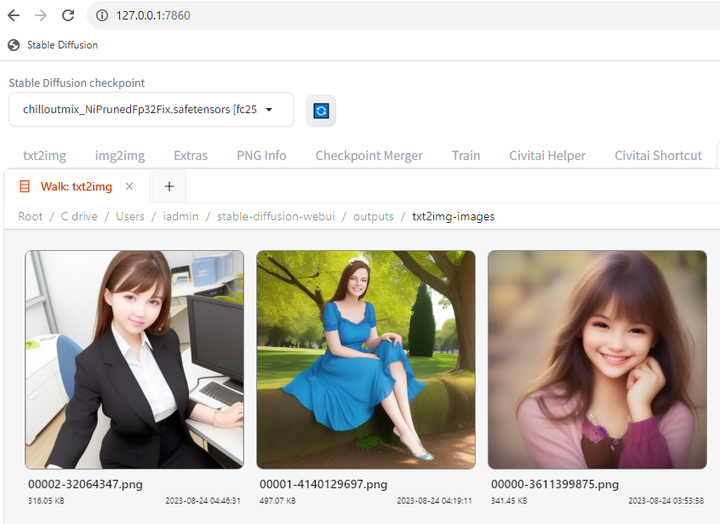

老電腦跑 VMware 17 Windows 10 VM 一張圖 10 分鐘

==

玩票性質, 驗證想法而已