我想解決的不只是影片字幕翻譯本身,而是整個字幕翻譯流程太瑣碎的問題:

從影片解析、音訊擷取、語音轉文字、字幕翻譯,到字幕匯出和掛載播放,雖然都各自有不錯的軟體工具,但每次總是要拼拼湊湊的才能完成整個流程,而ArcSub 就是想把這些事情整合起來在單一平台就能完成所有步驟。

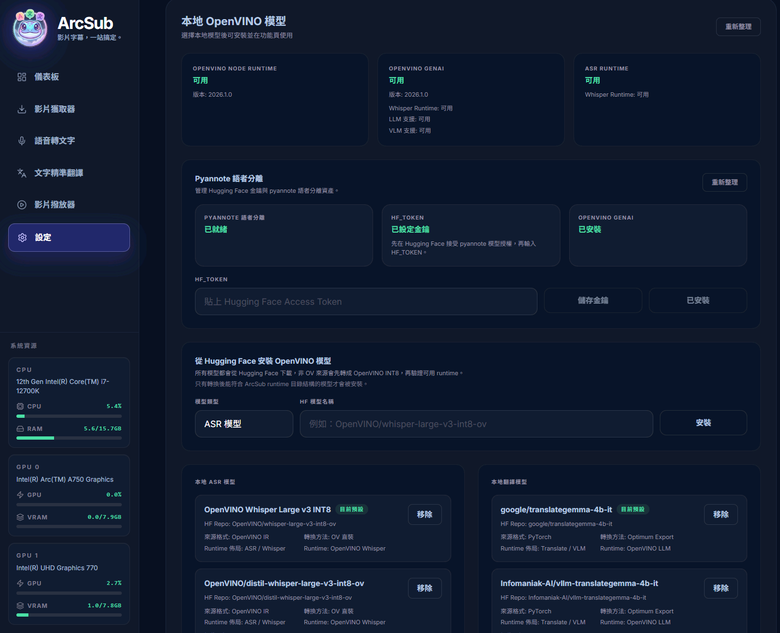

另外,這個工具比較不一樣的地方在於深度整合了OpenVINO,主要是因為我自己目前就是用Intel Arc A750,網路上許多不錯的開源方案都是針對N家的 CUDA 在優化,所以 Intel 的顯卡實際跑模型時速度通常很悲劇,這才讓我肝下去乾脆自己弄一套可以更好發揮 Intel 顯卡能力的工具。

但如果不是 Intel 顯卡也不用擔心,因為可以透過 Ollama、vLLM 這類服務在N卡上面跑模型,再用 API 串接來使用即可,都可以在設定頁面做模型安裝與串接。

這套工具本來是做給自己用的,但既然都肝了一段時間了,同步也分享給有需要的人。

如果你有興趣的話,歡迎到 GitHub 看看,覺得不錯的話也幫我按顆 Star。

https://github.com/brucexuego/ArcSub

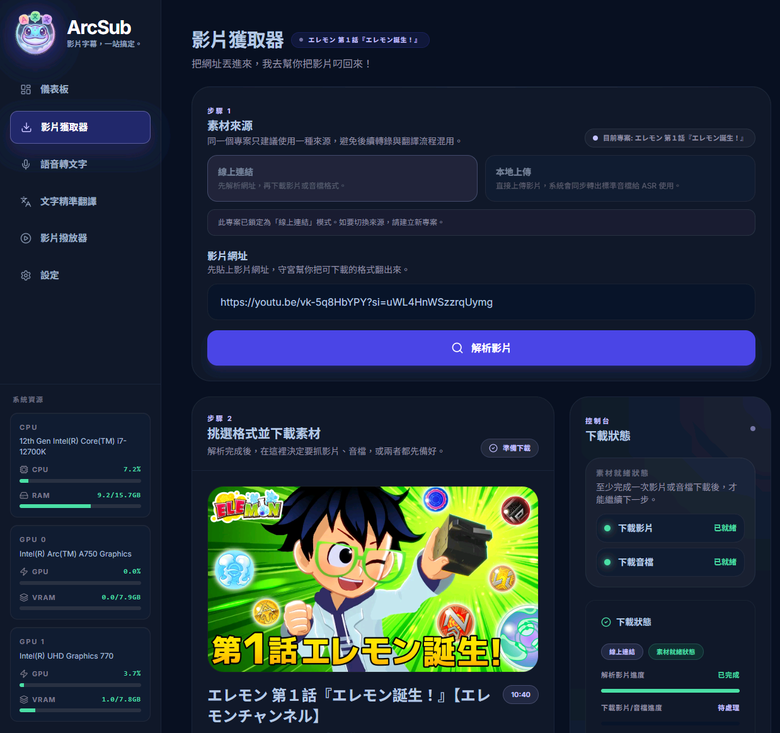

當你想看的線上影片沒有中文字幕或是不滿意即時翻譯的效果時,首先可以先下載音檔:

接著音檔會被正規化處理到語音轉錄的頁面,在這邊可以透過ASR模型將音檔轉錄成原文字幕,這一段是關鍵,會直接影響後續的翻譯品質,建議大家可以多嘗試不同的進階功能搭配看效果:

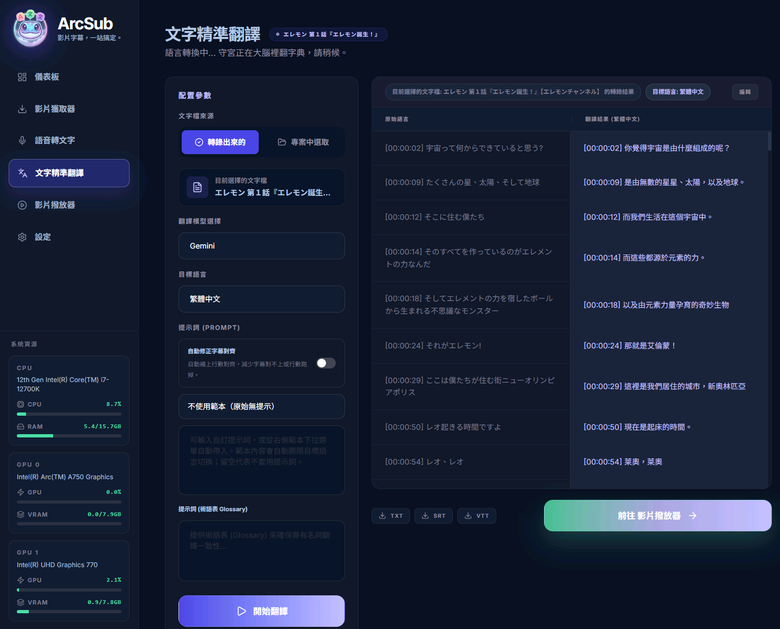

轉錄完的原文字幕可以直接送到文字翻譯頁面,相對於上一個步驟這邊可以玩的模型種類比較多,模型越強翻譯效果越好,但就要看你的顯卡VRAM有多大了,像我的只有8G可以用的模型基本上差強人意:

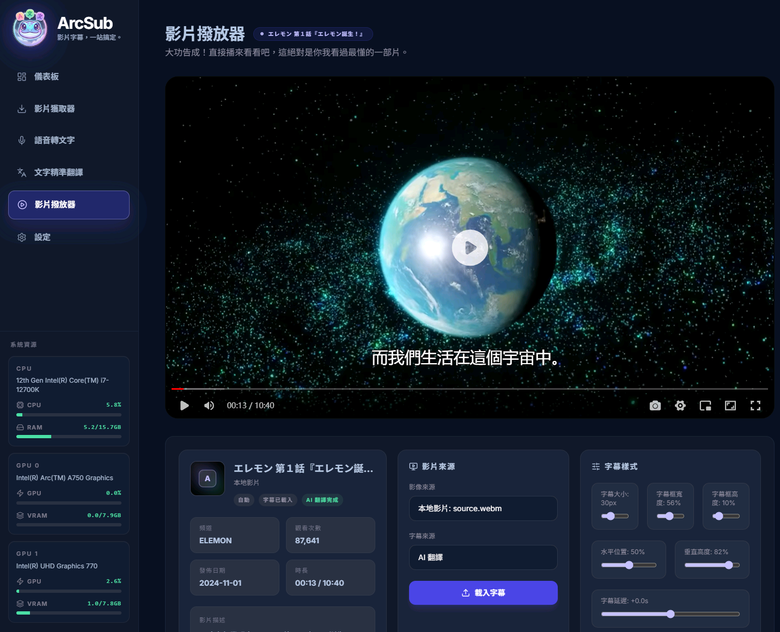

最後轉錄完的字幕可以直接掛載到撥放器來撥放跟看效果:

我盡量讓模型的安裝簡化,輸入HF上的模型ID就可以自動抓取安裝:

這邊有幾點注意事項:

1. Intel 顯卡的老硬傷,冷啟動太久了,常常會久到以為沒在動作。

2. 如果要做比較精準的字詞對齊,每個語言都需要專屬的校準模型,第一次啟用會自動去網路上安裝模型,所以轉錄時間會比較久一點。

3. OpenVINO雖然可以吃多種格式的模型,但真正效能好一點的只有他們優化過的IR格式模型,但效能上與N卡比還是有一段距離,只能希望官方再多積極一點優化好的模型了。